DeepSeek, ein chinesisches Unternehmen, hat kürzlich sein KI-Modell DeepSeek-R1 auf den Markt gebracht. Um es nutzen zu können, müssen Sie ein Konto auf der Website von DeepSeek erstellen. Die App ist auch für Android-Telefone und iPhones verfügbar. Sie können DeepSeek-R1 auch lokal auf Ihrem Computer einrichten und hosten, auch ohne Internetverbindung. Dies wird die destillierte Version des DeepSeek-R1 sein. Dieser Artikel zeigtwie man DeepSeek R1 oder DeepSeek V3 lokal unter Windows 11/10 ausführt.

Wer ist der Gründer von DeepSeek?

DeepSeek ist ein Startup-KI-Unternehmen mit Sitz in China. Ihr Gründer ist der 40-jährige Liang Wenfeng. Im Jahr 2023 wurde DeepSeek AI auf dem US-Markt in den App Stores von Google und Apple eingeführt. Nach ihrer Einführung stiegen die Downloadzahlen sprunghaft an und sie wurde zur am häufigsten heruntergeladenen App in den USA.

Um DeepSeek R1 lokal auf Ihrem Windows 11/10-Computer herunterzuladen, zu installieren und auszuführen, befolgen Sie diese Schritte:

- Installieren Sie Ollama

- Installieren Sie das DeepSeek R1-Modell mit cmd

- Installieren Sie die DeepSeek-Benutzeroberfläche

Alle diese Schritte werden im Folgenden ausführlich erläutert:

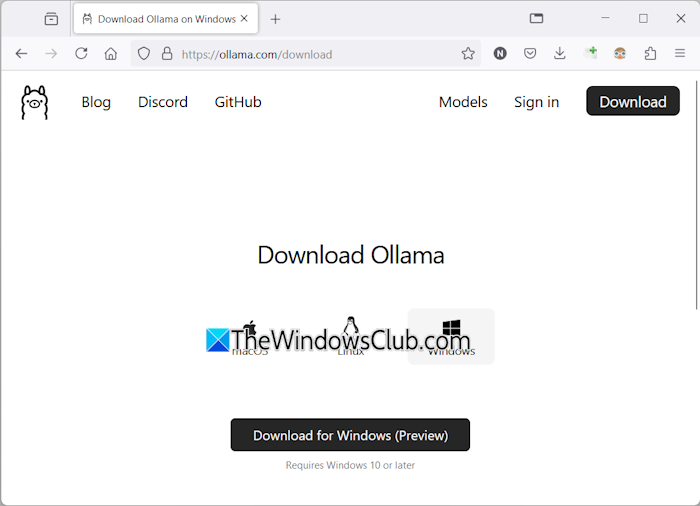

1] Installieren Sie Ollama

Der erste Schritt besteht darin, Ollama auf Ihrem Computer zu installieren. Sie können es hier herunterladenoffizielle Website. Führen Sie die Installationsdatei aus, um Ollama auf Ihrem Computer zu installieren. Besuchen Sie nach der Installation von Ollama erneut die offizielle Website und klicken Sie aufModelleRegisterkarte oben.

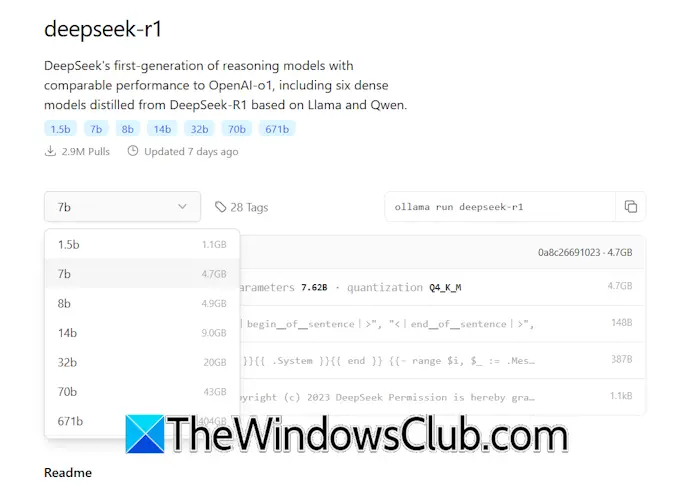

Dort sehen Sie das Modell deepseek-r1. Der DeepSeek-R1 ist in verschiedenen Parametern erhältlich, 1,5b, 7b, 8b, 14b usw. Das DeepSeek-R1-Modell mit größeren Parametern erfordert einen High-End-PC. Installieren Sie daher das DeepSeek-Modell entsprechend der Hardware Ihres Computers.

Wählen Sie im Dropdown-Menü das erforderliche DeepSeek-R1-Modell aus und kopieren Sie dann den erforderlichen Befehl. Nehmen wir an, Sie möchten das leichteste Modell von DeepSeek-R1 installieren. Der Befehl lautet:

ollama run deepseek-r1:1.5b

Um das DeepSeek-R1-Modell 14b zu installieren, lautet der Befehl:

ollama run deepseek-r1:14b

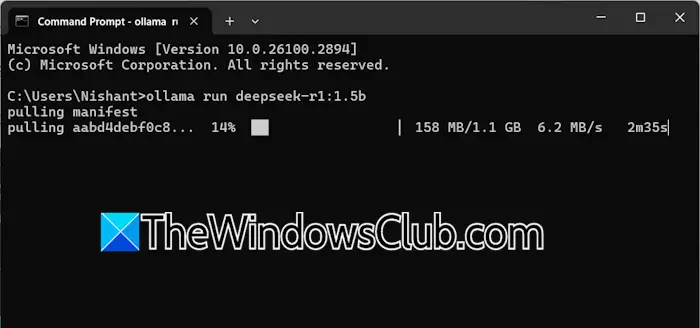

2] Installieren Sie das DeepSeek R1-Modell mit cmd

Der nächste Schritt besteht darin, den Befehl auszuführen, den Sie im obigen Schritt kopiert haben. Öffnen Sie die Eingabeaufforderung auf Ihrem Windows-Computer und fügen Sie den kopierten Befehl dort ein. SchlagEingebendanach.

Die Ausführung des Befehls kann je nach Modell, das Sie zur Installation ausgewählt haben, einige Zeit in Anspruch nehmen. Schließen Sie die Eingabeaufforderung erst, wenn der Befehl vollständig ausgeführt wurde.

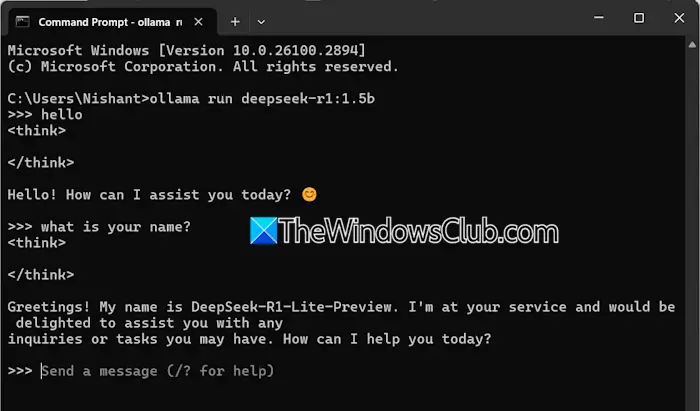

Nachdem der Befehl erfolgreich ausgeführt wurde, können Sie das DeepSeek-R1-Modell in der Eingabeaufforderung verwenden. Um das DeepSeek-R1-Modell das nächste Mal zu verwenden, öffnen Sie die Eingabeaufforderung und führen Sie denselben Befehl aus. Wenn Sie beispielsweise das DeepSeek-R1-Modell 1.5b installiert haben, führen Sie jedes Mal, wenn Sie es auf Ihrem System verwenden möchten, den folgenden Befehl im CMD aus:

ollama run deepseek-r1:1.5b

Jetzt können Sie mit dem DeepSeek-R1-Modell chatten. Die Verwendung des DeepSeek-R1-Modells in der Windows-Eingabeaufforderung hat einen Nachteil. Ihr Chatverlauf wird nicht gespeichert. Daher müssen Sie die Benutzeroberfläche installieren.

3] Installieren Sie die DeepSeek-Benutzeroberfläche

Die Installation der DeepSeek-R1-Benutzeroberfläche hat einen Vorteil gegenüber der Verwendung in der Windows-Eingabeaufforderung. Sie können Ihren vorherigen Chat-Verlauf anzeigen oder darauf zugreifen. Wir zeigen Ihnen, wie Sie das DeepSeek-R1-Modell lokal auf Ihrem Windows-Rechner hosten.

Sie können dies mit den folgenden zwei Methoden tun:

- Durch die Installation der Chatbox AI-App

- Durch die Installation der Docker-App

Führen Sie DeepSeek-R1 auf Ihrem Windows-Computer über die Chatbox AI aus

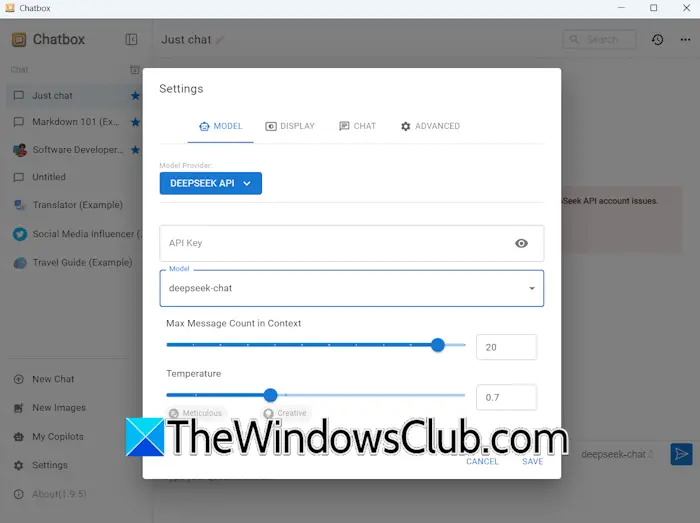

Besuchen Sie Chatbox AI'soffizielle Websiteund laden Sie die Installationsdatei herunter. Führen Sie die Installationsdatei aus, um die Chatbox AI zu installieren. Führen Sie nun die Chatbox AI aus und richten Sie sie auf Ihrem System ein. Öffnen Sie die Chatbox-App und gehen Sie zu ihren Einstellungen. Wählen Sie die ausDeepSeek-APIunter demMODELLTab. Geben Sie den DeepSeek-API-Schlüssel ein, um ihn zu aktivieren und die Änderungen zu speichern. Jetzt können Sie DeepSeek-R1 auf Ihrem System verwenden.

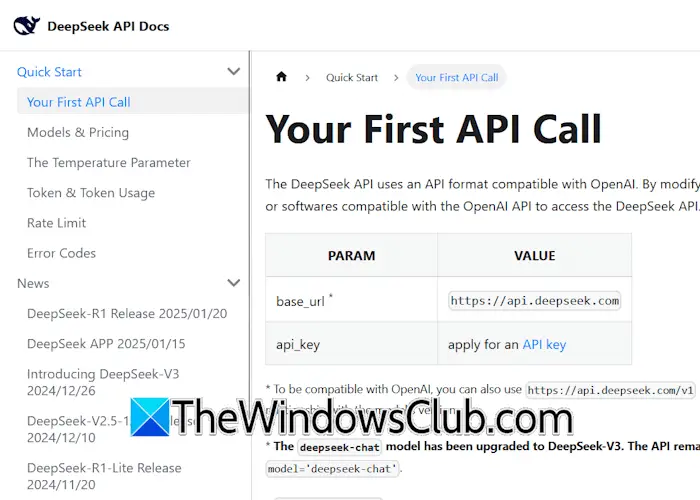

Den DeepSeek-API-Schlüssel erhalten Sie hieroffizielle Website. Wenn Sie den API-Schlüssel nicht erhalten können, können Sie eine andere Methode zur Installation der DeepSeek-R1-Benutzeroberfläche verwenden.

Führen Sie DeepSeek-R1 über die Docker-App auf Ihrem Windows-Computer aus

Wenn die obige Methode bei Ihnen nicht funktioniert, können Sie die Docker-App verwenden. Laden Sie die Docker-App von der offiziellen Website herunter und installieren Sie sie. Um Docker nutzen zu können, müssen Sie ein Konto auf der offiziellen Website von Docker erstellen.

Starten Sie nun die Docker-App und melden Sie sich mit demselben Konto an. Schließen Sie die Docker-App nicht. Lassen Sie es im Hintergrund laufen. Wenn Sie fertig sind, öffnen Sie die Eingabeaufforderung und führen Sie den folgenden Befehl aus:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

Die Ausführung des obigen Befehls wird einige Zeit in Anspruch nehmen. Unterbrechen Sie es nicht. Schließen Sie nach Abschluss des obigen Befehls die Eingabeaufforderung, gehen Sie zur Docker-App und wählen Sie „Containervon der linken Seite. Auf der rechten Seite sehen Sie einen neuen Container mit der Portnummer 3000:8080.

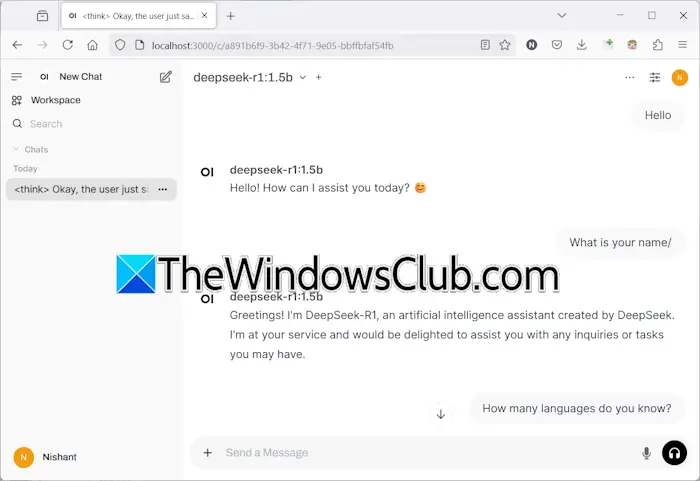

Klicken Sie in der Docker-App auf die Portnummer 3000:8080. In Ihrem Standard-Webbrowser wird ein neuer Tab mit der Adresse geöffnetlocalhost:3000. Richten Sie dort ein Konto ein, indem Sie Ihren Namen, Ihre E-Mail-ID und Ihr Passwort eingeben. Merken Sie sich diese Details, da Sie sie jedes Mal eingeben müssen, wenn Sie DeepSeek-R1 auf localhost auf Ihrem System starten.

Wenn Sie den Vorgang beenden möchten, melden Sie sich in Ihrem Webbrowser von DeepSeek ab. Die Option „Abmelden“ wird angezeigt, wenn Sie oben rechts auf Ihr Profilsymbol klicken. Öffnen Sie anschließend die Docker-App und klicken Sie aufStoppenTaste. Jetzt können Sie Docker schließen.

Beachten Sie, dass Ollama und Docker im Hintergrund auf Ihrem System ausgeführt werden müssen, um DeepSeek-R1 lokal in Ihrem Webbrowser zu verwenden. Starten Sie daher zuerst Ollama und dann die Docker-App. Der jeweilige Container sollte in der Docker-App laufen. Wenn der Container nicht ausgeführt wird, führen Sie ihn aus. Jetzt können Sie localhost:3000 in Ihrem Webbrowser aufrufen und sich mit demselben Konto anmelden, um DeepSeek-R1 zu verwenden.

Sie sollten wissen, dass DeepSeek Benutzerdaten wie Geräteinformationen, Tastendruckmuster, IP-Adressen und Chat-Verlauf sammelt und diese auf Servern in China speichert. Dies gilt jedoch nicht für lokale Modelle oder Apps, die mit DeepSeek erstellt wurden.

Ich hoffe, das hilft.

Lesen:

Wie führe ich Deepseek V3 0323 lokal aus?

DeepSeek V3 0323 ist ein fortschrittliches Mixture-of-Experts (MoE)-Sprachmodell, das für Hochleistungs-KI-Aufgaben entwickelt wurde. R1, das auf V3 aufbaut, beinhaltet Reinforcement Learning zur Verbesserung des Denkens und Problemlösens und zeichnet sich bei logiklastigen Aufgaben wie Codierung und mathematischer Analyse aus. Während V3 vielseitig und kostengünstig ist, ist R1 auf fortgeschrittenes Denken und strukturierte Problemlösung spezialisiert.

Um DeepSeek V3 auszuführen, können Sie die unten aufgeführten Schritte ausführen.

1. Laden Sie Python 3.9 herunter, installieren Sie es und fügen Sie es dem Pfad hinzu.

2. Installieren Sie dann Git vongit-scm.comund stellen Sie sicher, dass es mit git –version installiert wird.

3. Gehen Sie zuDeveloper.nvidia.comund laden Sie CUDA Toolkit Version 11.8 herunter.

4. Führen Sie die folgenden Befehle aus, um das Repository zu klonen.

git clone https://github.com/khanfar/DeepSeek-Windows.git

cd DeepSeek-Windows

python -m venv venv

venv\Scripts\activate

5. Jetzt müssen wir PyTorch und andere Anforderungen installieren.

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

pip install -r requirements.txt

6. Laden Sie als Nächstes die Modellgewichte mit dem folgenden Befehl herunter.

python download_model.py

7. Starten Sie abschließend den Server und testen Sie anschließend das Modell.

python windows_server.py --model model_weights_bf16 --trust-remote-code

python test_client.py

So können Sie mit der Nutzung des Servers beginnenhttps://127.0.0.1:30000.

Ist Deepseek kostenlos?

Derzeit ist die Nutzung von DeepSeek AI kostenlos. Es steht im Apple App Store und Google Play Store zum kostenlosen Herunterladen und Installieren zur Verfügung. Die Nutzung der Web-App ist ebenfalls kostenlos. Sie können die offizielle Website besuchen, um die Web-App zu nutzen. DeepSeek bietet außerdem kostenlosen Zugang zu DeepSeek-V3, früher bekannt als DeepSeek-Chat.

Lesen Sie weiter:.

![[Software-Update] Mozilla Firefox 133.0.3 Stable veröffentlicht, hier finden Sie die neuen und behobenen Änderungen](https://media.askvg.com/articles/images/Mozilla_Firefox_Browser.png)