ディープシーク、中国企業は最近、AI モデル DeepSeek-R1 を発売しました。これを使用するには、DeepSeek の Web サイトでアカウントを作成する必要があります。このアプリは Android スマートフォンや iPhone でも利用できます。インターネットに接続していなくても、コンピューター上でローカルに DeepSeek-R1 をセットアップしてホストすることもできます。これは DeepSeek-R1 の蒸留版になります。この記事が示すのは、Windows 11/10 で DeepSeek R1 または DeepSeek V3 をローカルで実行する方法。

DeepSeek の創設者は誰ですか?

DeepSeek は、中国に拠点を置く新興 AI 企業です。創設者は40歳の梁文峰氏。 2023 年に、DeepSeek AI は米国市場の Google および Apple App Store で開始されました。リリース後、ダウンロード数は急増し、米国で最もダウンロードされたアプリになりました。

DeepSeek R1 を Windows 11/10 コンピューターにローカルにダウンロード、インストールして実行するには、次の手順に従います。

- オラマをインストールする

- cmd を使用して DeepSeek R1 モデルをインストールする

- DeepSeek UI をインストールする

これらすべての手順については、以下で詳しく説明します。

1] Ollamaをインストールする

最初のステップは、Ollama をコンピュータにインストールすることです。そこからダウンロードできます公式ウェブサイト。インストーラー ファイルを実行して、Ollama をコンピューターにインストールします。 Ollama をインストールした後、再度公式 Web サイトにアクセスし、モデル上部のタブ。

そこに deepseek-r1 モデルが表示されます。 DeepSeek-R1 は、1.5b、7b、8b、14b などのさまざまなパラメータで利用できます。より大きなパラメータを備えた DeepSeek-R1 モデルには、ハイエンド PC が必要です。したがって、コンピューターのハードウェアに応じて DeepSeek モデルをインストールしてください。

ドロップダウン メニューから必要な DeepSeek-R1 モデルを選択し、必要なコマンドをコピーします。 DeepSeek-R1 の最軽量モデルをインストールするとします。コマンドは次のようになります。

ollama run deepseek-r1:1.5b

DeepSeek-R1 モデル 14b をインストールするには、コマンドは次のようになります。

ollama run deepseek-r1:14b

2] cmdを使用してDeepSeek R1モデルをインストールします

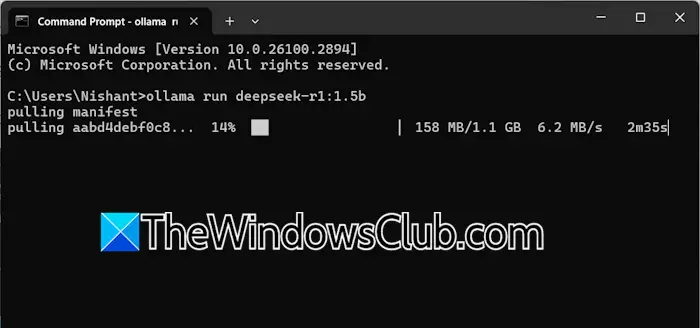

次のステップでは、上記のステップでコピーしたコマンドを実行します。 Windows コンピューターでコマンド プロンプトを開き、コピーしたコマンドをそこに貼り付けます。打つ入力その後。

インストール用に選択したモデルによっては、コマンドの実行に時間がかかります。コマンドが完全に実行されるまで、コマンド プロンプトを閉じないでください。

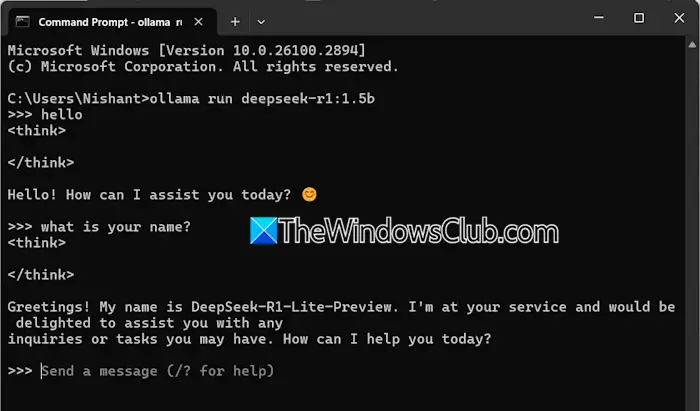

コマンドが正常に実行されると、コマンド プロンプトで DeepSeek-R1 モデルを使用できるようになります。次回 DeepSeek-R1 モデルを使用するには、コマンド プロンプトを開いて同じコマンドを実行します。たとえば、DeepSeek-R1 モデル 1.5b をインストールしている場合は、システムでそれを使用するたびに、CMD で次のコマンドを実行します。

ollama run deepseek-r1:1.5b

DeepSeek-R1 モデルとチャットできるようになりました。 Windows コマンド プロンプトで DeepSeek-R1 モデルを使用すると、欠点が 1 つあります。チャット履歴は保存されません。したがって、そのユーザー インターフェイスをインストールする必要があります。

3] DeepSeek UIをインストールする

DeepSeek-R1 UI をインストールすると、Windows コマンド プロンプトで使用するよりも利点があります。以前のチャット履歴を表示またはアクセスできます。 DeepSeek-R1 モデルを Windows マシン上でローカルにホストする方法を説明します。

これは、次の 2 つの方法で実行できます。

- Chatbox AI アプリをインストールすることで

- Dockerアプリをインストールすることで

Windows コンピュータ上で Chatbox AI を介して DeepSeek-R1 を実行する

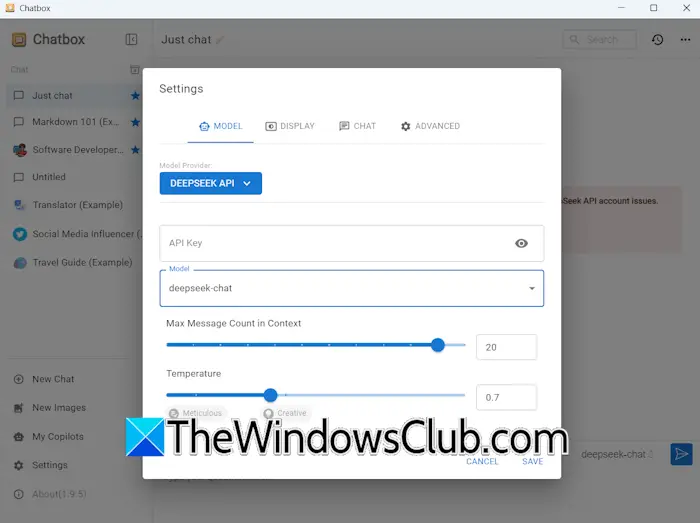

Chatbox AI にアクセス公式ウェブサイトそしてインストーラーファイルをダウンロードします。インストーラー ファイルを実行して Chatbox AI をインストールします。次に、Chatbox AI を実行し、システムに設定します。 Chatbox アプリを開き、[設定] に移動します。を選択します。ディープシーク APIの下にモデルタブ。 DeepSeek API キーを入力してアクティブ化し、変更を保存します。これで、システムで DeepSeek-R1 を使用する準備が整いました。

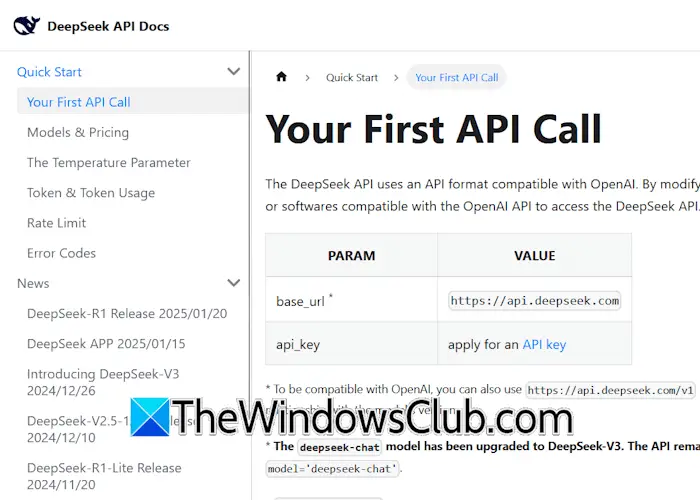

DeepSeek API キーは、公式ウェブサイト。 API キーを取得できない場合は、別の方法に従って DeepSeek-R1 UI をインストールできます。

Docker アプリを介して Windows コンピューターで DeepSeek-R1 を実行する

上記の方法がうまくいかない場合は、Docker アプリを使用できます。公式WebサイトからDockerアプリをダウンロードしてインストールします。 Docker を使用するには、Docker の公式 Web サイトでアカウントを作成する必要があります。

次に、Docker アプリを起動し、同じアカウントでサインインします。 Docker アプリを閉じないでください。バックグラウンドで実行させてください。完了したら、コマンド プロンプトを開き、次のコマンドを実行します。

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

上記のコマンドは完了するまでに時間がかかります。中断しないでください。上記のコマンドが完了したら、コマンド プロンプトを閉じ、Docker アプリに移動して、コンテナ左側から。右側にポート番号 3000:8080 の新しいコンテナが表示されます。

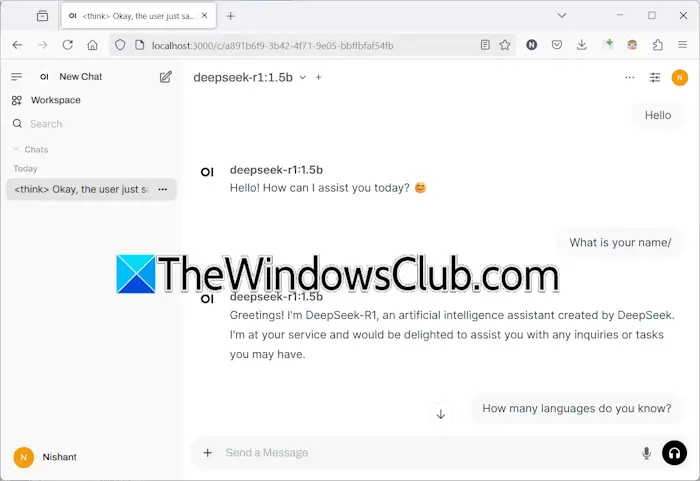

Docker アプリでポート番号 3000:8080 をクリックします。デフォルトの Web ブラウザで新しいタブが開き、次のアドレスが表示されます。ローカルホスト:3000。そこで名前、電子メール ID、パスワードを入力してアカウントを設定します。これらの詳細は、システムのローカルホストで DeepSeek-R1 を起動するたびに入力する必要があるため、覚えておいてください。

終了する場合は、Web ブラウザで DeepSeek からサインアウトします。右上にあるプロフィール アイコンをクリックすると、サインアウト オプションが表示されます。その後、Docker アプリを開き、停止ボタン。これで、Docker を閉じることができます。

Web ブラウザで DeepSeek-R1 をローカルで使用するには、Ollama と Docker がシステムのバックグラウンドで実行されている必要があることに注意してください。したがって、まず Ollama を起動し、次に Docker アプリを起動します。それぞれのコンテナが Docker アプリで実行されている必要があります。コンテナが実行されていない場合は、実行します。これで、Web ブラウザで localhost:3000 にアクセスし、同じアカウントでサインインして DeepSeek-R1 を使用できるようになります。

DeepSeek はデバイス情報、キーストローク パターン、IP アドレス、チャット履歴などのユーザー データを収集し、中国のサーバーに保存していることを知っておく必要があります。ただし、これはローカル モデルや DeepSeek で構築されたアプリには当てはまりません。

これがお役に立てば幸いです。

読む:

Deepseek V3 0323 をローカルで実行するにはどうすればよいですか?

DeepSeek V3 0323 は、高性能 AI タスク向けに設計された高度な専門家混合 (MoE) 言語モデルです。V3 上に構築された R1 には、推論と問題解決を強化する強化学習が組み込まれており、コーディングや数学的分析などのロジックを多用するタスクに優れています。 V3 は多用途でコスト効率が高いのに対し、R1 は高度な推論と構造化された問題解決に特化しています。

DeepSeek V3 を実行するには、以下の手順に従います。

1. Python 3.9 をダウンロードしてインストールし、パスに追加します。

2. 次に、Git をインストールします。git-scm.comgit –version を使用してインストールされていることを確認します。

3. に移動します開発者.nvidia.comCUDA Toolkit バージョン 11.8 をダウンロードします。

4. 次のコマンドを実行して、リポジトリのクローンを作成します。

git clone https://github.com/khanfar/DeepSeek-Windows.git

cd DeepSeek-Windows

python -m venv venv

venv\Scripts\activate

5. 次に、PyTorch とその他の要件をインストールする必要があります。

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

pip install -r requirements.txt

6. 次に、次のコマンドを使用してモデルの重みをダウンロードします。

python download_model.py

7. 最後に、サーバーを起動してモデルをテストします。

python windows_server.py --model model_weights_bf16 --trust-remote-code

python test_client.py

これにより、次の場所でサーバーの使用を開始できます。https://127.0.0.1:30000。

ディープシークは無料ですか?

現在、DeepSeek AI は無料で使用できます。 Apple App Store および Google Play ストアから無料でダウンロードしてインストールできます。そのウェブアプリも無料で使用できます。公式 Web サイトにアクセスして Web アプリを使用できます。 DeepSeek は、以前は DeepSeek チャットとして知られていた DeepSeek-V3 への無料アクセスも提供します。

次に読む:。