Recherche profonde, une entreprise chinoise, a récemment lancé son modèle d'IA, DeepSeek-R1. Pour l'utiliser, vous devez créer un compte sur le site Web de DeepSeek. Son application est également disponible pour les téléphones Android et les iPhones. Vous pouvez également configurer et héberger DeepSeek-R1 localement sur votre ordinateur, même sans connexion Internet. Ce sera la version distillée du DeepSeek-R1. Cet article montrecomment exécuter DeepSeek R1 ou DeepSeek V3 localement sur Windows 11/10.

Qui est le fondateur de DeepSeek ?

DeepSeek est une startup d'IA basée en Chine. Son fondateur est Liang Wenfeng, 40 ans. En 2023, DeepSeek AI a été lancé sur le marché américain sur les App Store de Google et d'Apple. Après son lancement, ses téléchargements ont grimpé en flèche et elle est devenue l'application la plus téléchargée aux États-Unis.

Pour télécharger, installer et exécuter DeepSeek R1 localement sur votre ordinateur Windows 11/10, suivez ces étapes :

- Installer Ollama

- Installer le modèle DeepSeek R1 avec cmd

- Installer l'interface utilisateur DeepSeek

Toutes ces étapes sont expliquées en détail ci-dessous :

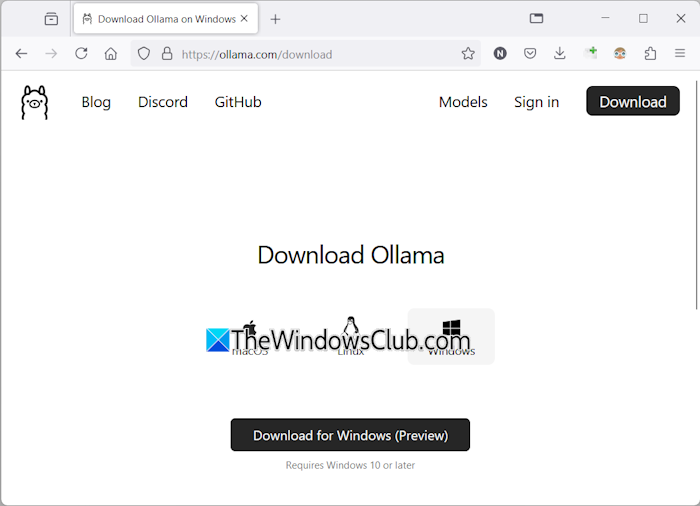

1] Installer Ollama

La première étape consiste à installer Ollama sur votre ordinateur. Vous pouvez le télécharger depuis sonsite officiel. Exécutez le fichier d’installation pour installer Ollama sur votre ordinateur. Après avoir installé Ollama, visitez à nouveau son site officiel et cliquez sur leModèlesonglet en haut.

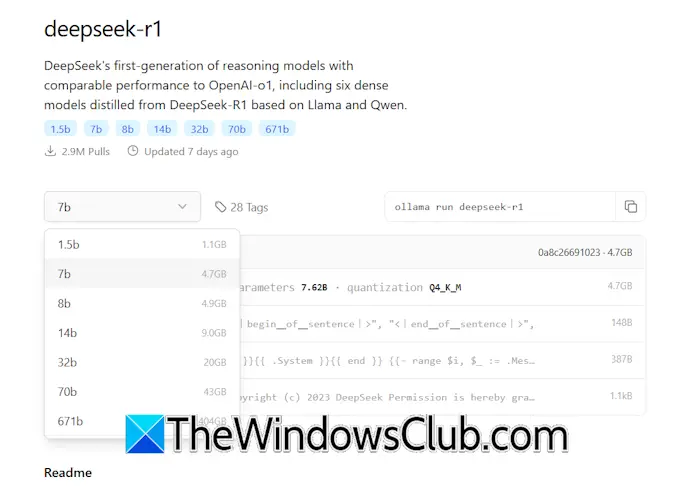

Vous y verrez le modèle deepseek-r1. Le DeepSeek-R1 est disponible en différents paramètres, 1.5b, 7b, 8b, 14b, etc. Le modèle DeepSeek-R1 avec des paramètres plus grands nécessite un PC haut de gamme. Par conséquent, installez le modèle DeepSeek en fonction du matériel de votre ordinateur.

Sélectionnez le modèle DeepSeek-R1 requis dans le menu déroulant, puis copiez la commande requise. Disons que vous souhaitez installer le modèle le plus léger de DeepSeek-R1, la commande sera :

ollama run deepseek-r1:1.5b

Pour installer le DeepSeek-R1 modèle 14b, la commande sera :

ollama run deepseek-r1:14b

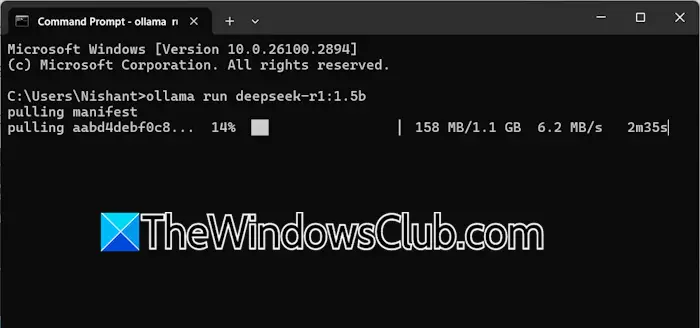

2] Installez le modèle DeepSeek R1 avec cmd

L'étape suivante consiste à exécuter la commande que vous avez copiée à l'étape ci-dessus. Ouvrez l'invite de commande sur votre ordinateur Windows et collez-y la commande copiée. FrapperEntreraprès cela.

L'exécution de la commande prendra un certain temps, selon le modèle que vous avez sélectionné pour l'installation. Ne fermez pas l'invite de commande tant que la commande n'est pas complètement exécutée.

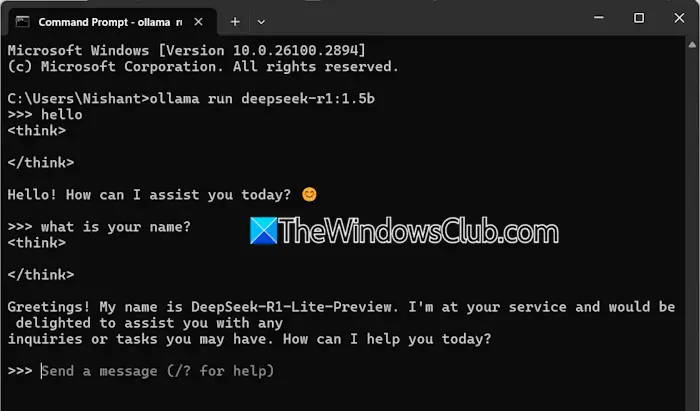

Une fois la commande exécutée avec succès, vous pouvez utiliser le modèle DeepSeek-R1 dans l'invite de commande. Pour utiliser le modèle DeepSeek-R1 la prochaine fois, ouvrez l'invite de commande et exécutez la même commande. Par exemple, si vous avez installé le modèle DeepSeek-R1 1.5b, exécutez la commande suivante dans le CMD chaque fois que vous souhaitez l'utiliser sur votre système :

ollama run deepseek-r1:1.5b

Désormais, vous pouvez discuter avec le modèle DeepSeek-R1. L'utilisation du modèle DeepSeek-R1 dans l'invite de commande Windows présente un inconvénient. Votre historique de discussion ne sera pas enregistré. Par conséquent, vous devez installer son interface utilisateur.

3] Installer l'interface utilisateur DeepSeek

L'installation de l'interface utilisateur DeepSeek-R1 présente un avantage par rapport à son utilisation dans l'invite de commande Windows. Vous pouvez afficher ou accéder à votre historique de discussion précédent. Nous allons vous montrer comment héberger le modèle DeepSeek-R1 localement sur votre machine Windows.

Vous pouvez le faire via les deux méthodes suivantes :

- En installant l'application Chatbox AI

- En installant l'application Docker

Exécutez DeepSeek-R1 sur votre ordinateur Windows via Chatbox AI

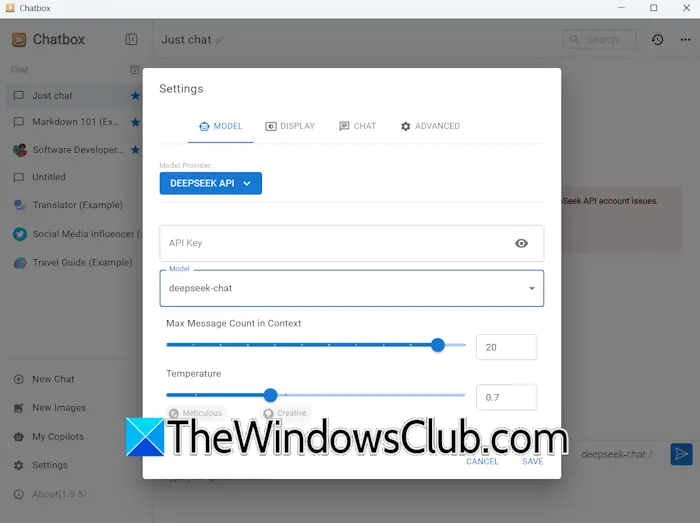

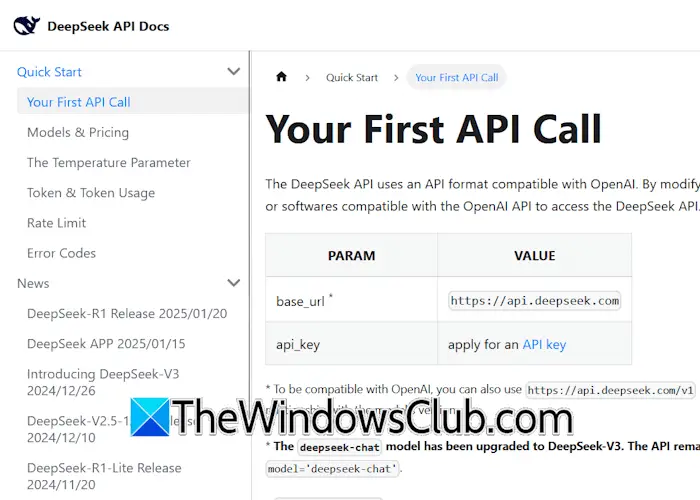

Visitez Chatbox AIsite officielet téléchargez son fichier d'installation. Exécutez le fichier d’installation pour installer Chatbox AI. Maintenant, exécutez Chatbox AI et configurez-le sur votre système. Ouvrez l'application Chatbox et accédez à ses paramètres. Sélectionnez leAPI DeepSeeksous leMODÈLElanguette. Entrez la clé API DeepSeek pour l'activer et enregistrer les modifications. Vous êtes maintenant prêt à utiliser DeepSeek-R1 sur votre système.

Vous pouvez obtenir la clé API DeepSeek à partir de sonsite officiel. Si vous ne parvenez pas à obtenir la clé API, vous pouvez suivre une autre méthode pour installer l'interface utilisateur DeepSeek-R1.

Exécutez DeepSeek-R1 sur votre ordinateur Windows via l'application Docker

Si la méthode ci-dessus ne fonctionne pas pour vous, vous pouvez utiliser l'application Docker. Téléchargez l'application Docker sur le site officiel et installez-la. Pour utiliser Docker, vous devez créer un compte sur le site officiel de Docker.

Maintenant, lancez l'application Docker et connectez-vous avec le même compte. Ne fermez pas l'application Docker. Laissez-le fonctionner en arrière-plan. Lorsque vous avez terminé, ouvrez l'invite de commande et exécutez la commande suivante :

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

La commande ci-dessus prendra un certain temps. Ne l'interrompez pas. Une fois la commande ci-dessus terminée, fermez l'invite de commande, accédez à l'application Docker et sélectionnezConteneursdu côté gauche. Vous verrez un nouveau conteneur sur le côté droit avec le numéro de port 3000:8080.

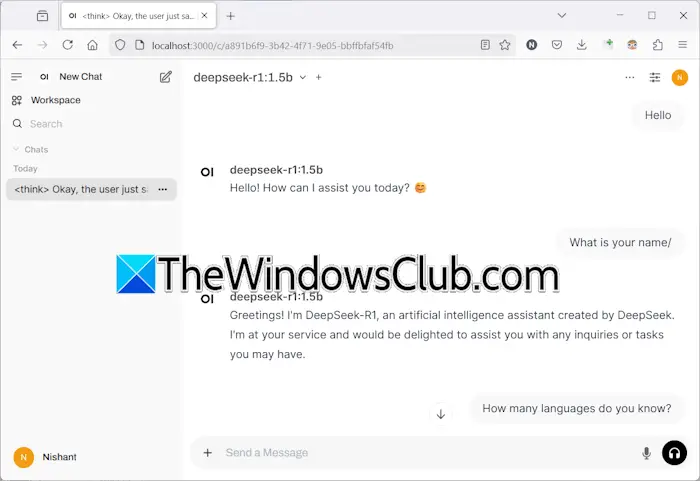

Cliquez sur le numéro de port 3000:8080 dans l'application Docker. Un nouvel onglet s'ouvrira dans votre navigateur Web par défaut avec l'adressehôte local : 3000. Créez-y un compte en entrant votre nom, votre identifiant de messagerie et votre mot de passe. N'oubliez pas ces détails, car vous devez les saisir à chaque fois que vous lancez DeepSeek-R1 sur localhost sur votre système.

Lorsque vous souhaitez quitter, déconnectez-vous de DeepSeek dans votre navigateur Web. L'option de déconnexion deviendra visible lorsque vous cliquerez sur l'icône de votre profil en haut à droite. Après cela, ouvrez l'application Docker et cliquez sur leArrêtbouton. Maintenant, vous pouvez fermer Docker.

Notez que pour utiliser DeepSeek-R1 dans votre navigateur Web localement, Ollama et Docker doivent s'exécuter en arrière-plan sur votre système. Par conséquent, lancez d’abord Ollama, puis lancez l’application Docker. Le conteneur correspondant doit être exécuté dans l'application Docker. Si le conteneur n'est pas en cours d'exécution, exécutez-le. Maintenant, vous pouvez visiter localhost:3000 dans votre navigateur Web et vous connecter avec le même compte pour utiliser DeepSeek-R1.

Vous devez savoir que DeepSeek collecte des données utilisateur telles que les informations sur l'appareil, les modèles de frappe, les adresses IP et l'historique des discussions et les stocke sur des serveurs en Chine. Mais cela ne s'applique pas aux modèles locaux ou aux applications créées avec DeepSeek.

J'espère que cela aide.

Lire:

Comment exécuter Deepseek V3 0323 localement ?

DeepSeek V3 0323 est un modèle de langage avancé de mélange d'experts (MoE) conçu pour les tâches d'IA hautes performances. R1, construit sur la V3, intègre l'apprentissage par renforcement pour améliorer le raisonnement et la résolution de problèmes, excellant dans les tâches lourdes de logique comme le codage et l'analyse mathématique. Alors que la V3 est polyvalente et rentable, la R1 se spécialise dans le raisonnement avancé et la résolution structurée de problèmes.

Pour exécuter DeepSeek V3, vous pouvez suivre les étapes mentionnées ci-dessous.

1. Téléchargez et installez Python 3.9 et ajoutez-le au chemin.

2. Ensuite, installez Git depuisgit-scm.comet assurez-vous qu'il est installé à l'aide de git –version.

3. Allez àdéveloppeur.nvidia.comet téléchargez la version 11.8 de CUDA Toolkit.

4. Exécutez les commandes suivantes pour cloner le référentiel.

git clone https://github.com/khanfar/DeepSeek-Windows.git

cd DeepSeek-Windows

python -m venv venv

venv\Scripts\activate

5. Maintenant, nous devons installer PyTorch et d’autres exigences.

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

pip install -r requirements.txt

6. Ensuite, téléchargez les poids du modèle à l'aide de la commande suivante.

python download_model.py

7. Enfin, démarrez le serveur puis testez le modèle.

python windows_server.py --model model_weights_bf16 --trust-remote-code

python test_client.py

C'est ainsi que vous pouvez commencer à utiliser le serveur àhttps://127.0.0.1:30000.

Deepseek est-il gratuit ?

Actuellement, DeepSeek AI est gratuit. Il est disponible sur Apple App Store et Google Play Store pour être téléchargé et installé gratuitement. Son application Web est également gratuite. Vous pouvez visiter son site officiel pour utiliser son application Web. DeepSeek propose également un accès gratuit à son DeepSeek-V3, anciennement connu sous le nom de DeepSeek-chat.

Lire ensuite:.

![[Changelog] Nouveautés de Microsoft Edge 120 et versions ultérieures](https://media.askvg.com/articles/images7/Chromium_Based_Microsoft_Edge_Web_Browser.png)